今朝は、口パクで音声入力ができるメガネ型デバイスをピックアップします。口パク、つまりは声を発しないで口だけを動かすということですが、口の動作を読み取るだけで、どのように音声入力が可能で、この技術は一体どのような意図があり、どのように展開されるのでしょうか。今朝は、本研究を手掛けていらっしゃいます、立命館大学情報理工学部 助教、そしてデジタルスピリッツテックラボ代表でいらっしゃいます双見京介さんと繋がります。

JK : 「口パク(無声発話)で音声入力が行えるメガネ型デバイス」ということですが、どのような仕組みでしょうか。

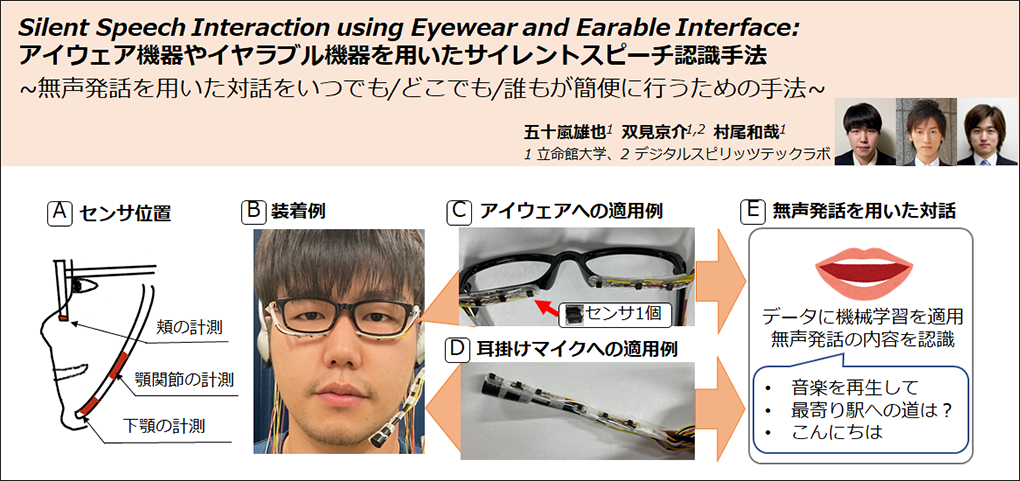

KF :人が発話する際に頬や顎関節、そして顔の皮膚が動きますが、これらの動きを2ミリ角の小型センサーでモニターします。赤外線の反射距離を利用したセンサーで皮膚の動きのデータを取ります。このセンサーを、眼鏡などアイウェアの下縁の内側に向けて付けたり、顎関節の動きを取るために耳にかけるイヤホンマイクなどの内側に付けます。これらのデータを機械学習にかけると口の動きがどのような単語や文章を喋っていたかを認識し、認識した内容に応じてコンピューターを反応させるとか、言語に変換して人に送るとかが可能になります。例えば、「こんにちは」と実際に声を発さなくとも、その口の動きだけで認識できるようになるということです。

JK : 様々な言葉と顔の動きのデータに紐付けてあって、そこからデータを引っ張るということでしょうか。

KF :事前にその人、若しくは他の人がどの単語を発話する時にどのような口の動かし方をするか、というデータを取っておいて、それらと照合します。膨大な量の言葉全てを網羅しようとするならば大変な作業ですが、現在の研究段階では「入力操作用」のように用途を簡単なものに絞れば、20種類のデータだけで入力操作の活動はまかなえます。

JK : 例えば、どのような操作が可能ですか。

KF : 例えば、スマートスピーカーを使って音声でコマンドするような内容です。眼鏡型のデバイスをかけて「今日の天気は?」だったり「XXまでの道順教えて」など、スマートスピーカーに皆さんが指示するであろうことを、顔の動きをモニターすることで音声入力できます。

JK : 実際に利用されるのはどのような属性の方々でしょうか。

KF : 先天的にも後天的にも発声が困難な方々とか、御高齢で喋りにくい方々に使って頂けると考えています。健常者の方でも、人がいる屋外だと喋った内容が漏れてしまうというセキュリティの懸念がありますよね。その他にも、喋るのが恥ずかしいとか、コロナ感染が心配とか、電車の中で声を出せないとか、などの理由で発声しづらい状況もあるかと思います。そのような局面で口パクでの音声入力を使って頂きたいです。将来的には、コンピューターを使う人全てが口パクで喋った方がいいと思われる場面で使えるようになるのが理想です。

JK : コミュニケーションの用途以外で、例えば、顔が動くというのは食事をしたり、咀嚼したり、言葉を発しないけど表情を読み取るとか、そのような応用はどうイメージされていますか。

KF : 音声入力以外では、人の重要な活動をモニターして、それに応じて人を変える働きかけをするというポテンシャルがあります。例えば食事に関して言えば、いつどこでどれくらいの食事をしたかモニターすることが可能になります。それに応じて、血糖値の上昇を抑えるべき人がいたら、咀嚼回数を無意識に増加させるように誘導するとか、あるいは食事量を無意識に減少させてダイエットに誘導するとか、そのような働きかけをモニターと併せて視覚、聴覚、振動の情報を出すことでサポートが可能になります。食事、喋っている時間、表情の変化も記録できるので、色々楽しくて役立つ仕組みを感げています。

JK : 特にお一人住まいの高齢者の方々が今後爆発的に増えることが想定されますので、そのような方々の健康管理にもマルチに活用できそうですね。今後の展開、是非引き続き追わせてください!

Yuya Igarashi, Kyosuke Futami, and Kazuya Murao. 2022. Silent Speech Eyewear Interface: Silent Speech Recognition Method using Eyewear with Infrared Distance Sensors. In Proceedings of the 2022 ACM International Symposium on Wearable Computers(ISWC '22). Association for Computing Machinery, New York, NY, USA, 33-38. https://doi.org/10.1145/3544794.3558458